Einführung

Mit der wachsenden Popularität von Bereichen wie Deep Learning, 3D-Modellierung/-Rendering, VR-Gaming und Krypto-Mining sind die Anforderungen an moderne Computer sprunghaft gestiegen. Die Hardwarekomponenten, die für die Bereitstellung der Rechenleistung zuständig sind, wurden entsprechend der Nachfrage weiterentwickelt. Diese Entwicklung erreichte einen Punkt, an dem es manchmal schwierig ist, zwischen ihren Rollen im Computersystem zu unterscheiden.

Dieser Artikel bietet einen umfassenden Vergleich zwischen den beiden wichtigsten Computer-Engines – der CPU und der GPU.

CPU vs. GPU:Übersicht

Nachfolgend finden Sie eine Übersicht über die wichtigsten Vergleichspunkte zwischen CPU und GPU.

| CPU | GPU |

|---|---|

| Eine kleinere Anzahl größerer Kerne (bis zu 24) | Eine größere Anzahl (Tausende) kleinerer Kerne |

| Geringe Latenz | Hoher Durchsatz |

| Optimiert für Serienverarbeitung | Optimiert für parallele Verarbeitung |

| Entwickelt für die Ausführung komplexer Programme | Entwickelt für einfache und sich wiederholende Berechnungen |

| Führt weniger Anweisungen pro Takt aus | Führt mehr Anweisungen pro Takt aus |

| Automatisches Cache-Management | Ermöglicht die manuelle Speicherverwaltung |

| Kosteneffizient für kleinere Workloads | Kosteneffizient für größere Arbeitslasten |

Was ist eine CPU?

Die CPU (Central Processing Unit) oder der Hauptprozessor führt Rechenanweisungen aus. Die CPU ist über einen CPU-Sockel mit dem Motherboard verbunden und wartet auf Eingaben von einem Computerprogramm oder einem Peripheriegerät wie einer Tastatur, einer Maus oder einem Touchpad. Es interpretiert und verarbeitet dann die Eingabe und sendet die resultierende Ausgabe an Peripheriegeräte oder speichert sie im Speicher.

Was ist eine GPU?

Die GPU (Graphics Processing Unit) ist ein spezialisierter Grafikprozessor, der entwickelt wurde, um Tausende von Operationen gleichzeitig verarbeiten zu können. Anspruchsvolle 3D-Anwendungen erfordern eine parallele Textur-, Mash- und Lichtverarbeitung, damit sich Bilder reibungslos über den Bildschirm bewegen, und die CPU-Architektur ist für diese Aufgaben nicht optimiert. Der ursprüngliche Zweck von GPUs bestand darin, das Rendern von Grafiken zu beschleunigen.

Unterschied zwischen CPU und GPU

Obwohl es sich bei beiden um siliziumbasierte Verarbeitungschips handelt, unterscheiden sich CPUs und GPUs erheblich in Architektur und Anwendung.

CPU vs. GPU-Architektur

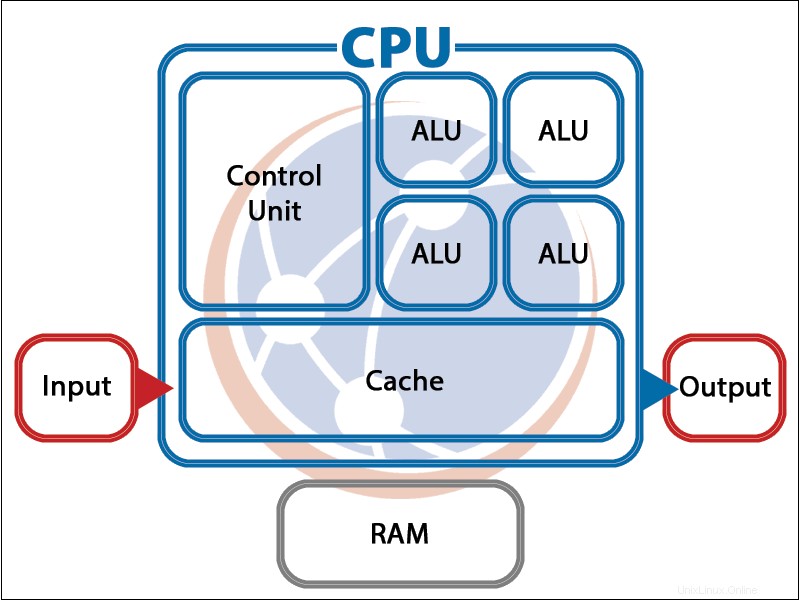

Die CPU besteht aus Milliarden von Transistoren, die zu Logikgattern verbunden sind, die dann zu Funktionsblöcken verbunden werden. In größerem Maßstab hat die CPU drei Hauptkomponenten:

- Arithmetische und logische Einheit (ALU) besteht aus Schaltungen, die arithmetische und logische Operationen ausführen.

- Die Steuereinheit holt Anweisungen von der Eingabe und leitet sie an ALUs, Cache, RAM oder Peripheriegeräte weiter.

- Zwischenspeichern speichert Zwischenwerte, die für ALU-Berechnungen erforderlich sind, oder hilft beim Verfolgen von Unterroutinen und Funktionen in dem Programm, das ausgeführt wird.

CPUs können mehrere Kerne mit eigenen ALUs, Steuereinheiten und Cache haben.

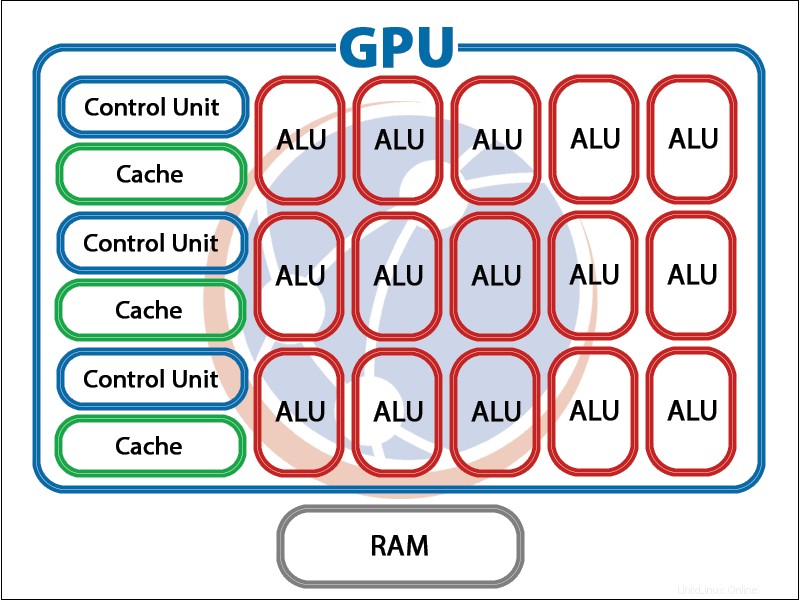

Die GPU besteht aus ähnlichen Komponenten, verfügt jedoch über eine viel größere Anzahl kleinerer, spezialisierter Kerne. Der Zweck mehrerer Kerne besteht darin, der GPU zu ermöglichen, mehrere parallele Rechenoperationen auszuführen .

CPU vs. GPU-Rendering

GPUs wurden in erster Linie für die Grafikmanipulation entwickelt, was erklärt, warum sie CPUs in der Rendering-Geschwindigkeit so überlegen sind. Abhängig von der Qualität der einzelnen Hardwarekomponenten kann das GPU-Rendering bis zu hundert Mal schneller sein als das CPU-Rendering.

Ein gutes Rendering-Erlebnis hängt jedoch nicht nur von der Geschwindigkeit ab. Beispielsweise erfordert die Arbeit mit 3D-Visuals die Durchführung mehrerer komplexer Aufgaben, während die Daten synchron gehalten werden. CPUs sind auf Komplexität ausgelegt und tendieren dazu, GPUs beim 3D-Rendering zu übertreffen, da GPUs für einfachere und unkompliziertere Aufgaben ausgelegt sind.

Darüber hinaus sind GPUs auf ihren Grafikkartenspeicher (normalerweise bis zu 12 GB) beschränkt, der nicht gestapelt werden kann und nicht einfach erweitert werden kann, ohne Engpässe zu verursachen und die Leistung zu beeinträchtigen. Die CPU nutzt den Hauptsystemspeicher, der leicht erweiterbar ist und bis zu 64 GB erreichen kann.

CPU-Cache vs. GPU-Cache

Die CPU verwendet den Cache, um Zeit und Energie zu sparen, die zum Abrufen von Daten aus dem Speicher benötigt werden. Der Cache ist kleiner, schneller und näher an den anderen CPU-Komponenten als der Hauptspeicher.

Der CPU-Cache besteht aus mehreren Schichten. Die Ebene, die dem Kern am nächsten ist, wird nur von diesem Kern verwendet, während die am weitesten entfernte Ebene von allen CPU-Kernen geteilt wird. Moderne CPUs führen das Cache-Management automatisch durch. Jede Ebene entscheidet basierend auf der Nutzungshäufigkeit, ob das Stück Speicher behalten oder entfernt werden soll.

Der lokale GPU-Speicher ist dem CPU-Cache strukturell ähnlich. Der wichtigste Unterschied besteht jedoch darin, dass der GPU-Speicher eine uneinheitliche Speicherzugriffsarchitektur aufweist. Es ermöglicht Programmierern zu entscheiden, welche Speicherteile im GPU-Speicher verbleiben und welche entfernt werden sollen, was eine bessere Speicheroptimierung ermöglicht.

CPU vs. GPU-Deep-Learning

Deep Learning ist ein Bereich, in dem GPUs deutlich besser abschneiden als CPUs. Die folgenden wichtigen Faktoren tragen zur Beliebtheit von GPU-Servern beim Deep Learning bei:

- Speicherbandbreite - Der ursprüngliche Zweck von GPUs bestand darin, das 3D-Rendering von Texturen und Polygonen zu beschleunigen, daher wurden sie für die Verarbeitung großer Datensätze entwickelt. Der Cache ist zu klein, um die Datenmenge zu speichern, die eine GPU wiederholt verarbeitet, daher verfügen GPUs über breitere und schnellere Speicherbusse.

- Große Datensätze - Deep-Learning-Modelle erfordern große Datensätze. Die Effizienz von GPUs bei der Verarbeitung speicherintensiver Berechnungen macht sie zu einer logischen Wahl.

- Parallelität - GPUs verwenden Thread-Parallelität, um das Latenzproblem zu lösen, das durch die Größe der Daten verursacht wird - die gleichzeitige Verwendung mehrerer Verarbeitungs-Threads.

- Kosteneffizienz - Große neuronale Netzwerk-Workloads erfordern viel Hardwareleistung. Dafür bieten GPU-basierte Systeme deutlich mehr Ressourcen für weniger Geld.

CPU vs. GPU-Mining

Während GPU-Mining tendenziell teurer ist, haben GPUs eine höhere Hash-Rate als CPUs. GPUs führen bis zu 800-mal mehr Anweisungen pro Takt aus als CPUs, wodurch sie effizienter bei der Lösung der komplexen mathematischen Probleme sind, die für das Mining erforderlich sind. GPUs sind außerdem energieeffizienter und einfacher zu warten.

Wie CPU und GPU zusammenarbeiten?

Beim Vergleich der beiden ist es wichtig zu verstehen, dass GPUs entwickelt wurden, um CPUs zu ergänzen, nicht um sie zu ersetzen. Die CPU und die GPU arbeiten zusammen, um die Menge und Geschwindigkeit der verarbeiteten Daten zu erhöhen.

Eine GPU kann eine CPU in einem Computersystem nicht ersetzen. Die CPU ist notwendig, um die Ausführung von Aufgaben auf dem System zu überwachen. Die CPU kann jedoch bestimmte sich wiederholende Arbeitslasten an die GPU delegieren und ihre eigenen Ressourcen freisetzen, die für die Aufrechterhaltung der Stabilität des Systems und der ausgeführten Programme erforderlich sind.